Ostatnio NVIDIA udostępniła kod źródłowy StyleGAN3, oparty na generatywnej niekorzystnej sieci neuronowej (GAN) system uczenia maszynowego do syntezy realistycznych obrazów ludzkich twarzy.

W styluGAN3 gotowe do użycia przeszkolone modele są dostępne do pobrania w kolekcji Flickr-Faces-HQ (FFHQ), który zawiera 70 1024 wysokiej jakości (1024×2) obrazów PNG przedstawiających ludzkie twarze. Ponadto dostępne są modele zbudowane na podstawie kolekcji AFHQvXNUMX (fotografie twarzy zwierząt) oraz Metfaces (obrazy twarzy ludzi z portretów klasycznego malarstwa).

O StyleGAN3

projektowanie skupia się na twarzach, ale system można wytrenować do generowania dowolnego typu obiektów, jak krajobrazy i samochody. Oprócz, dostarczane są narzędzia do samouczenia się sieci neuronowej korzystając z własnych kolekcji obrazów. Wymaga jednej lub więcej kart graficznych NVIDIA (zalecane procesory graficzne Tesla V100 lub A100), co najmniej 12 GB pamięci RAM, PyTorch 1.9 i CUDA Toolkit 11.1+. Aby określić sztuczny charakter otrzymanych twarzy, opracowywany jest specjalny detektor.

System pozwala na syntezę obrazu nowej twarzy na podstawie interpolacji cech kilku twarzy, łącząc ich nieodłączne cechy, a także dostosowując ostateczny obraz do wymaganego wieku, płci, długości włosów, charakteru uśmiechu, kształtu nosa, koloru skóry, okularów, kąta fotografowania.

Generator traktuje obraz jako zbiór stylów, automatycznie oddziela charakterystyczne szczegóły (piegi, włosy, okulary) o ogólnych atrybutach wysokiego poziomu (postawa, płeć, zmiany związane z wiekiem) i pozwala na dowolne łączenie ich z definiowaniem dominujących cech za pomocą współczynników wagowych, w wyniku czego obrazy są pozornie nie do odróżnienia od rzeczywistych fotografii.

Pierwsza wersja technologii StyleGAN (wydana w 2019 r.), a następnie ulepszona wersja StyleGAN2 w 2020 r., która poprawia jakość obrazu i usuwa niektóre artefakty. Jednocześnie system pozostał statyczny, to znaczy nie pozwalał na realistyczne animacje ani ruchy twarzy. Podczas opracowywania StyleGAN3 głównym celem było dostosowanie technologii do wykorzystania w animacji i wideo.

StyleGAN3 wykorzystuje przeprojektowaną architekturę obrazowania bez aliasingu.ay oferuje nowe scenariusze szkoleniowe dotyczące sieci neuronowych, a także zawiera nowe narzędzia do interaktywnej wizualizacji (visualizer.py), analizy (avg_spectra.py) i generowania wideo (gen_video.py). Implementacja zmniejsza również zużycie pamięci i przyspiesza proces uczenia się.

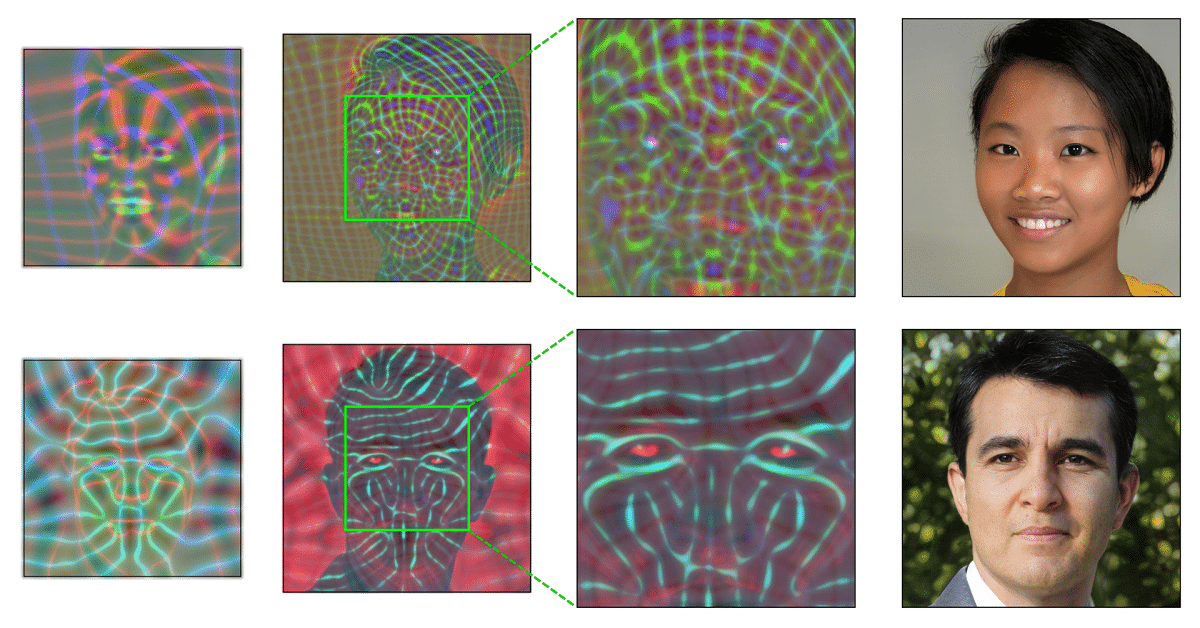

Kluczową cechą architektury StyleGAN3 było przejście do interpretacji wszystkich sygnałów w sieci neuronowej w postaci procesów ciągłych, co umożliwiło manipulowanie względnymi pozycjami poprzez formowanie części niezwiązanych ze współrzędnymi bezwzględnymi poszczególnych pikseli obrazu, ale przymocowanych do powierzchni renderowanych obiektów.

Podczas w StyleGAN i StyleGAN2 przyciąganie do pikseli podczas renderowania powodowało problemy z dynamicznym renderowaniemNa przykład, gdy obraz się poruszał, występowało niedopasowanie drobnych szczegółów, takich jak zmarszczki i włosy, które wydawały się poruszać oddzielnie od reszty obrazu twarzy, a ponadto w StyleGAN3 problemy te zostały rozwiązane, a technologia stała się całkiem odpowiednia do generowania wideo.

Wreszcie, również warto wspomnieć zapowiedź stworzenie przez firmy NVIDIA i Microsoft największego modelu językowego MT-NLG oparty na głębokiej sieci neuronowej o architekturze „transformacyjnej”.

Model obejmuje 530 miliardów parametrów i wykorzystano grupę 4480 GPU do szkoleń (560 serwerów DGX A100 z 8 procesorami graficznymi A100 o pojemności 80 GB każdy). Obszary zastosowania modelu nazywane są rozwiązywaniem problemów przetwarzania informacji w języku naturalnym, takich jak przewidywanie zakończenia niedokończonego zdania, odpowiadanie na pytania, czytanie ze zrozumieniem, formułowanie wniosków w języku naturalnym i analiza niejednoznaczności znaczenia słów.

Jeśli chcesz dowiedzieć się więcej na ten temat, możesz sprawdzić szczegóły StyleGAN3 W poniższym linku.