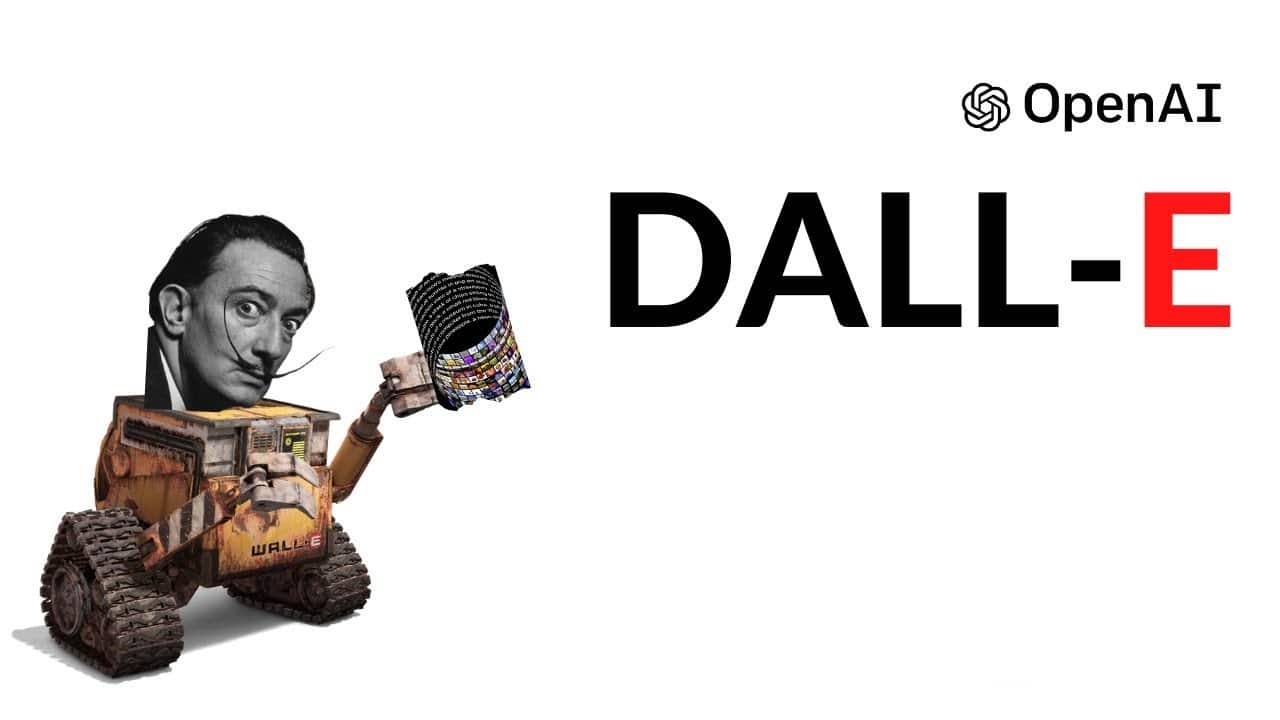

לפני כמה ימים OpenAI חשפה כי DALL-E 2, מערכת הבינה המלאכותית שיכולה ליצור תמונות ממודעה או לערוך ולחדד תמונות קיימות, זמין כעת בגרסת בטא וכי היא גם תאיץ את הגישה של לקוחות ברשימת ההמתנה במטרה להגיע לכ-1 מיליון איש בשבועות הקרובים.

עם מהדורת "ביתא" זו, DALL-E 2, אשר היה חופשי לשימוש, הוא יעבור למבנה עמלות מבוסס על קרדיטים. משתמשים חדשים יקבלו מספר מוגבל של קרדיטים שניתן להשתמש בהם כדי ליצור או לערוך תמונה או ליצור וריאציה של תמונה.

OpenAI הודיעה על כך הייתי מזמין עוד אנשים לנסות את זה, שכן היא מתכננת להכניס עד 1 מיליון אנשים מרשימת ההמתנה שלה במהלך השבועות הקרובים כשהיא עוברת משלב המחקר לשלב הבטא שלו.

לא ברור אם DALL-E אי פעם יהיה זמין במלואו לציבור, אך ההרחבה צפויה להיות מבחן גדול עבור הפלטפורמה, כאשר חוקרים רבים עוקבים אחר אופן השימוש לרעה בטכנולוגיה.

OpenAI שמרה על DALL-E במעקב צמוד מחשש שאנשים זדוניים ישתמשו בכלי רב עוצמה זה כדי להפיץ מידע מוטעה. תארו לעצמכם מישהו מנסה להשתמש בו כדי להמציא תמונות של המלחמה באוקראינה או ליצור תמונות מציאותיות של אסונות טבע שמעולם לא קרו. כמו כן, בניית תדמית עם הפלטפורמה צורכת כל כך הרבה כוח עד שגורמים בחברה חששו שהשרתים שלה ייכשלו אם יותר מדי אנשים ינסו להשתמש בה בו זמנית.

בנוסף לכמה אחרים תכונות חדשות, ההבדל העיקרי עם הדגם השני הזה הוא גדול שיפור רזולוציית התמונה, זמן אחזור נמוך יותר (הזמן שלוקח ליצירת התמונה) ואלגוריתם חכם יותר ליצירת התמונות.

התוכנה לא רק יוצרת תמונה עם סגנון ייחודי, יכול להוסיף טכניקות אמנות שונות כבקשתך, כניסה לסגנונות ציור, ציור שמן, חימר דוגמנות, סריגה בצמר, מצויירת על קיר מערה, או אפילו ככרזה לסרט משנות ה-60.

יש גם דרכים לתמרץ את Dall-E לייצר תוכן. שהמונח מבקש לסנן. בעוד שהדם יפעיל את מסנן האלימות, משתמש יכול להקליד "שלולית קטשופ" או משהו דומה בניסיון לעקוף אותו.

כשזה מגיע לטכנולוגיה סביב הדמיה בינה מלאכותית, נראה ברור שניתן לתמרן אותה בדרכים רבות: תעמולה, חדשות מזויפות ותמונות מדוייקות עולות בראש כדרכים ברורות.

כדי להימנע מכך, צוות OpenAI מאחורי Dall-E יישם מדיניות אבטחה עבור כל התמונות בפלטפורמה זה עובד בשלושה שלבים. הצעד הראשון הוא לסנן את הנתונים הכוללים הפרה גדולה. זה כולל אלימות, תוכן מיני ותמונות שהצוות יראה כלא הולם.

בנוסף למדיניות האבטחה של הצוות, יש מדיניות תוכן ברורה שמשתמשים חייבים לציית להובכן, ג'ואן ג'אנג, מנהלת מוצר של DALL-E, אומרת שהחברה עדיין מכוונת את מדיניות התוכן שלה, האוסרת כעת על מה שהיית מצפה*: יצירת תוכן אלים, פורנוגרפי ומעורר שנאה. החברה גם אוסרת תמונות המתארות קלפיות והפגנות,

DALL-E גם אוסר על הצגות של אנשים אמיתיים ומתכננת להפעיל אמצעי אבטחה נוספים כאשר החוקרים שלה לומדים כיצד משתמשים מקיימים אינטראקציה עם המערכת.

"כרגע, אנחנו חושבים שיש הרבה עלומים שהיינו רוצים לטפל בהם טוב יותר", אמר ג'אנג. "אנחנו מתכננים להגביר במהירות ולהזמין עוד ועוד אנשים ככל שנקבל ביטחון עצמי".

מומחים אומרים שלמרות שאלגוריתמי הדמיה קיימים כבר זמן מה, המהירות, הדיוק והרוחב של DALL-E מייצגים התקדמות מדהימה בתחום.

"מה ש-DALL-E עושה הוא ללכוד אלמנט מהדמיון האנושי. זה לא באמת שונה מהאופן שבו בני אדם יכולים לקרוא ספר ולדמיין דברים, אבל זה להיות מסוגל ללכוד את האינטליגנציה הזו באמצעות אלגוריתם", אמר פיליפ איזולה, פרופסור למדעי המחשב ב-MIT שעבד בעבר עם Open AI אבל כבר לא קשור . "כמובן, יש הרבה חששות לגבי האופן שבו ניתן לעשות שימוש לרעה בטכנולוגיה זו."

בסופו של דבר אם אתה מעוניין לדעת יותר על כך, אתה יכול לבדוק את הפרטים בקישור הבא.