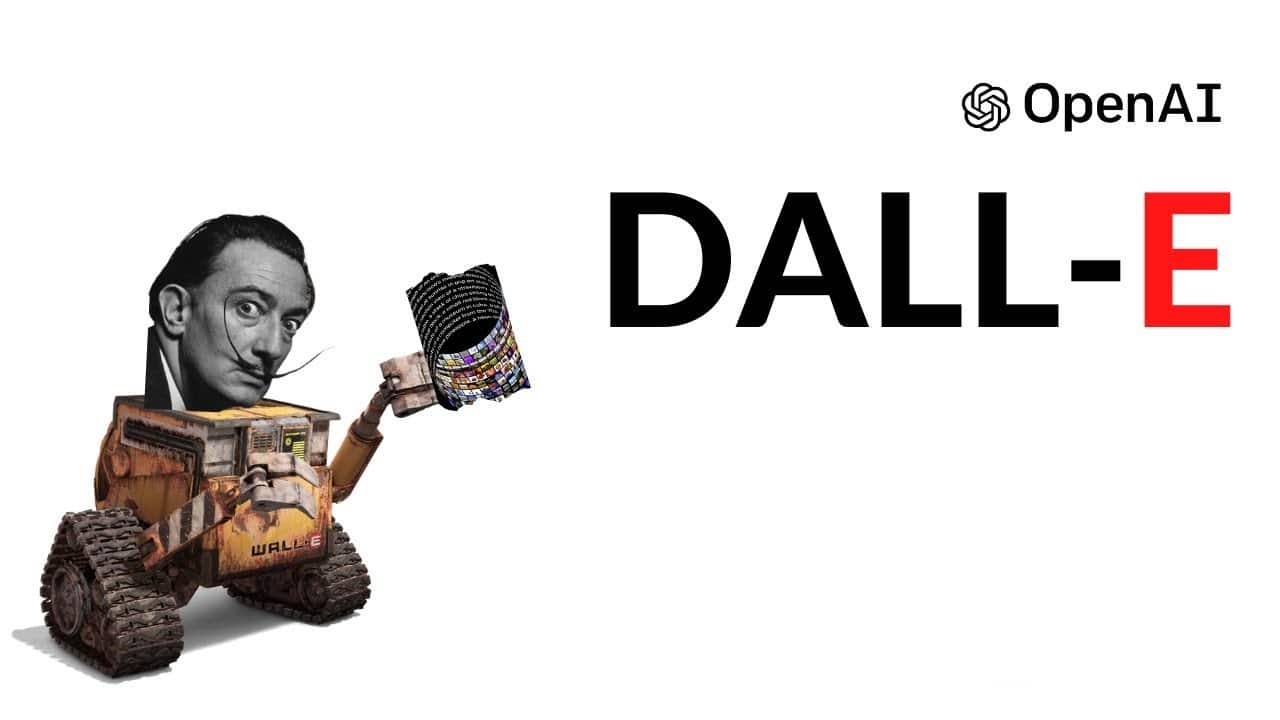

数日前 OpenAIはDALL-E 2を明らかにした、広告から画像を生成したり、既存の画像を編集および改良したりできる人工知能システム ベータ版で利用可能になりました また、今後数週間で約 1 万人に到達することを目指して、順番待ちリストにある顧客へのアクセスも高速化します。

この「ベータ」リリースでは、DALL-E 2 が 無料で利用できたが、有料に移行する クレジットに基づく。 新規ユーザーは、画像の生成または編集、または画像のバリエーションの作成に使用できる限られた数のクレジットを取得します。

OpenAIが発表した もっと多くの人に試してもらいたい、研究段階からベータ段階に移行するにつれて、今後数週間で待機リストから最大1万人を受け入れる予定であるため.

DALL-E が完全に一般公開されるようになるかどうかは不明ですが、この拡張はプラットフォームの主要なテストになると予想されており、多くの研究者がこの技術がどのように悪用されるかを監視しています。

OpenAI は、悪意のある個人がこの強力なツールを使用して誤った情報を広めることを恐れて、DALL-E を綿密に監視しています。 誰かがそれを使って、ウクライナでの戦争の画像を捏造したり、決して起こらなかった自然災害のリアルな画像を作成したりしようとしていると想像してみてください。 また、このプラットフォームでイメージを構築するのは非常に多くの電力を消費するため、会社の関係者は、あまりにも多くの人が同時に使用しようとするとサーバーが故障するのではないかと心配していました.

他のいくつかに加えて 新機能、この XNUMX 番目のモデルとの主な違いは素晴らしいです。 画像解像度の向上、レイテンシーの低下 (画像の作成にかかる時間) と、画像を作成するためのよりスマートなアルゴリズム。

このソフトウェアは、独自のスタイルで画像を作成するだけでなく、 リクエストに応じてさまざまなアートテクニックを追加できます。 ドローイング スタイル、油絵、モデリング クレイ、ウール ニット、洞窟の壁に描かれたもの、さらには 60 年代の映画のポスターとしても登場します。

Dall-E がコンテンツを作成するように動機付ける方法もあります。 用語がフィルタリングしようとしていること。 血は暴力フィルターをトリガーしますが、ユーザーは「ケチャップの水たまり」などを入力して、それをバイパスしようとする可能性があります。

AI 画像に関する技術に関して言えば、さまざまな方法で操作できることは明らかです。プロパガンダ、フェイク ニュース、改ざんされた画像が明らかな方法として思い浮かびます。

これを回避するには、 Dall-E の背後にある OpenAI チームは、セキュリティ ポリシーを実装しました プラットフォーム上のすべてのイメージに対して、XNUMX つの段階で機能します。 最初のステップは、重大な違反を含むデータをフィルタリングすることです。 これには、チームが不適切と見なす暴力、性的コンテンツ、および画像が含まれます。

チームのセキュリティ ポリシーに加えて、 ユーザーが遵守しなければならない明確なコンテンツ ポリシーがあるDALL-E のプロダクト マネージャーである Joanne Jang 氏によると、同社はまだコンテンツ ポリシーを微調整しており、今ではあなたが期待する*こと、つまり暴力的、ポルノ的、憎悪に満ちたコンテンツの作成を禁止しています。 同社はまた、投票箱や抗議を描いた画像を禁止しています。

DALL-E はまた、実在の人物の描写を禁止しており、研究者がユーザーがシステムとどのようにやり取りするかを知るにつれて、より多くのセキュリティ対策を導入する予定です。

「現時点では、より適切に処理したい不明な点がたくさんあると考えています」と Jang 氏は述べています。 「自信がつき次第、迅速に立ち上げて、より多くの人を招待する予定です。」

専門家によると、画像処理アルゴリズムはしばらく前から存在していましたが、DALL-E の速度、精度、および幅は、この分野における目覚ましい進歩を表しています。

「DALL-E が行うことは、人間の想像力の要素を捉えることです。 人間が本を読んで物事を想像する方法と実際には何の違いもありませんが、その知性をアルゴリズムで捉えることができます」と、MIT のコンピューター サイエンス教授であり、以前は Open AI に取り組んでいましたが、現在は所属していません。 . 「もちろん、この種の技術が悪用される可能性については多くの懸念があります。」

最後に あなたがそれについてもっと知りたいなら、詳細を確認できます 次のリンクで。