Récemment NVIDIA a publié le code source de StyleGAN3, un système d'apprentissage automatique basé sur des réseaux de neurones indésirables génératifs (GAN) pour synthétiser des images réalistes de visages humains.

Dans le styleGAN3 sont disponibles pour télécharger des modèles entraînés prêts à l'emploi formés dans la collection Flickr-Faces-HQ (FFHQ), qui comprend 70 1024 images PNG de visages humains de haute qualité (1024 × 2). En outre, il existe des modèles construits sur la base des collections AFHQvXNUMX (photographies de visages d'animaux) et Metfaces (images de visages de personnes issues de portraits en peinture classique).

À propos de StyleGAN3

La conception se concentre sur les visages, mais le système peut être entraîné pour générer tout type d'objet, comme les paysages et les voitures. En outre, des outils sont fournis pour l'auto-apprentissage du réseau de neurones en utilisant vos propres collections d'images. Nécessite une ou plusieurs cartes graphiques NVIDIA (GPU Tesla V100 ou A100 recommandé), au moins 12 Go de RAM, PyTorch 1.9 et CUDA 11.1+ Toolkit. Pour déterminer le caractère artificiel des visages reçus, un détecteur spécial est en cours de développement.

Le système permet de synthétiser une image d'un nouveau visage à partir de l'interpolation des traits de plusieurs visages, combinant leurs caractéristiques inhérentes, en plus d'adapter l'image finale à l'âge, au sexe, à la longueur des cheveux, au caractère du sourire, à la forme du nez, à la couleur de la peau, aux lunettes, à l'angle photographique.

Le générateur traite l'image comme une collection de styles, sépare automatiquement les détails caractéristiques (taches de rousseur, cheveux, lunettes) des attributs généraux de haut niveau (posture, sexe, changements liés à l'âge) et permet de les combiner arbitrairement avec la définition des propriétés dominantes par le biais de facteurs de pondération et qu'en conséquence, des images sont générées qui ils sont apparemment indiscernables des photographies réelles.

La première version de la technologie StyleGAN (sortie en 2019), suivie d'une version améliorée de StyleGAN2 en 2020, qui améliore la qualité de l'image et supprime certains artefacts. Dans le même temps, le système restait statique, c'est-à-dire qu'il ne permettait pas d'animations réalistes ni de mouvements du visage. Lors du développement de StyleGAN3, l'objectif principal était d'adapter la technologie pour une utilisation dans l'animation et la vidéo.

StyleGAN3 utilise une architecture d'imagerie sans alias repenséeay propose de nouveaux scénarios de formation sur les réseaux neuronaux et comprend également de nouveaux utilitaires pour la visualisation interactive (visualizer.py), l'analyse (avg_spectra.py) et la génération vidéo (gen_video.py). L'implémentation réduit également la consommation de mémoire et accélère le processus d'apprentissage.

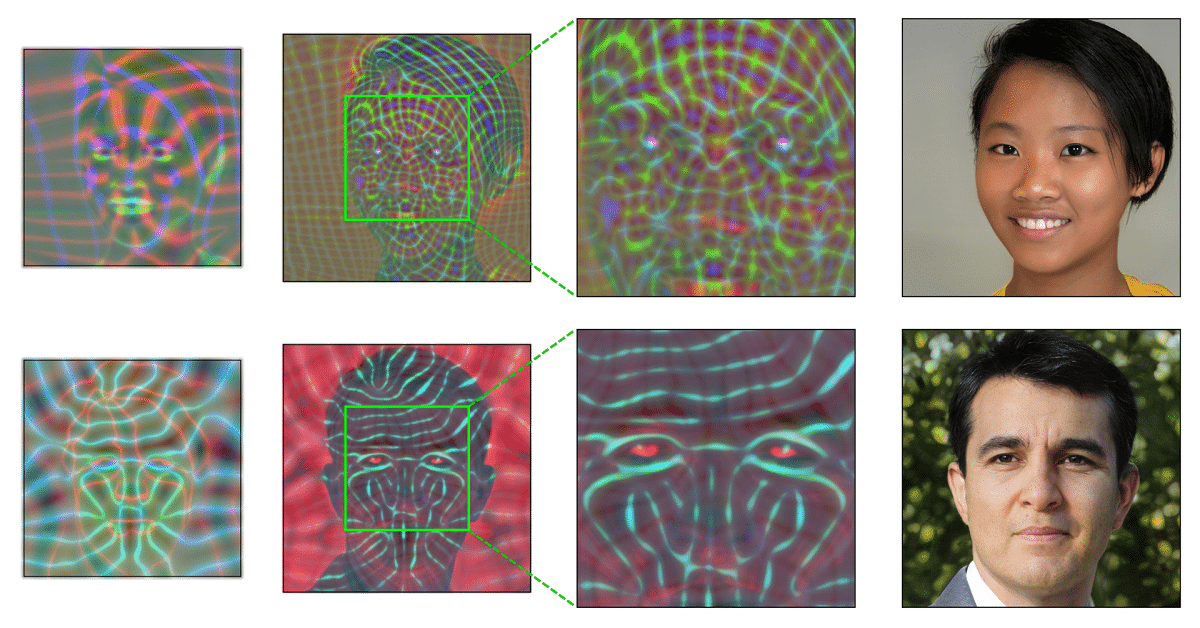

Une caractéristique clé de l'architecture StyleGAN3 était la transition vers l'interprétation de tous les signaux dans le réseau de neurones sous la forme de processus continus, ce qui a permis de manipuler des positions relatives en formant des parties, non liées aux coordonnées absolues des pixels individuels dans le image, mais fixée à la surface des objets représentés.

Alors que dans StyleGAN et StyleGAN2, l'accrochage aux pixels pendant la construction a causé des problèmes avec le rendu dynamiquePar exemple, lorsque l'image bougeait, il y avait un décalage de petits détails, tels que les rides et les poils, qui semblaient se déplacer séparément du reste de l'image du visage, en plus de cela dans StyleGAN3, ces problèmes sont résolus et la technologie a devenir tout à fait approprié pour la génération vidéo.

Enfin, mérite également d'être mentionné l'annonce de la création par NVIDIA et Microsoft du plus grand modèle de langage MT-NLG basé sur un réseau de neurones profonds avec une architecture « transformatrice ».

Le modèle couvre 530 milliards de paramètres et un pool de 4480 GPU a été utilisé pour la formation (560 serveurs DGX A100 avec 8 GPU A100 de 80 Go chacun). Les domaines d'application du modèle sont appelés résolution de problèmes de traitement de l'information en langage naturel, tels que la prédiction de l'achèvement d'une phrase inachevée, la réponse à des questions, la compréhension de la lecture, la formation de conclusions en langage naturel et l'analyse de l'ambiguïté du sens des mots. .

Si cela vous intéresse d'en savoir plus, vous pouvez vérifier les détails de StyleGAN3 dans le lien suivant.