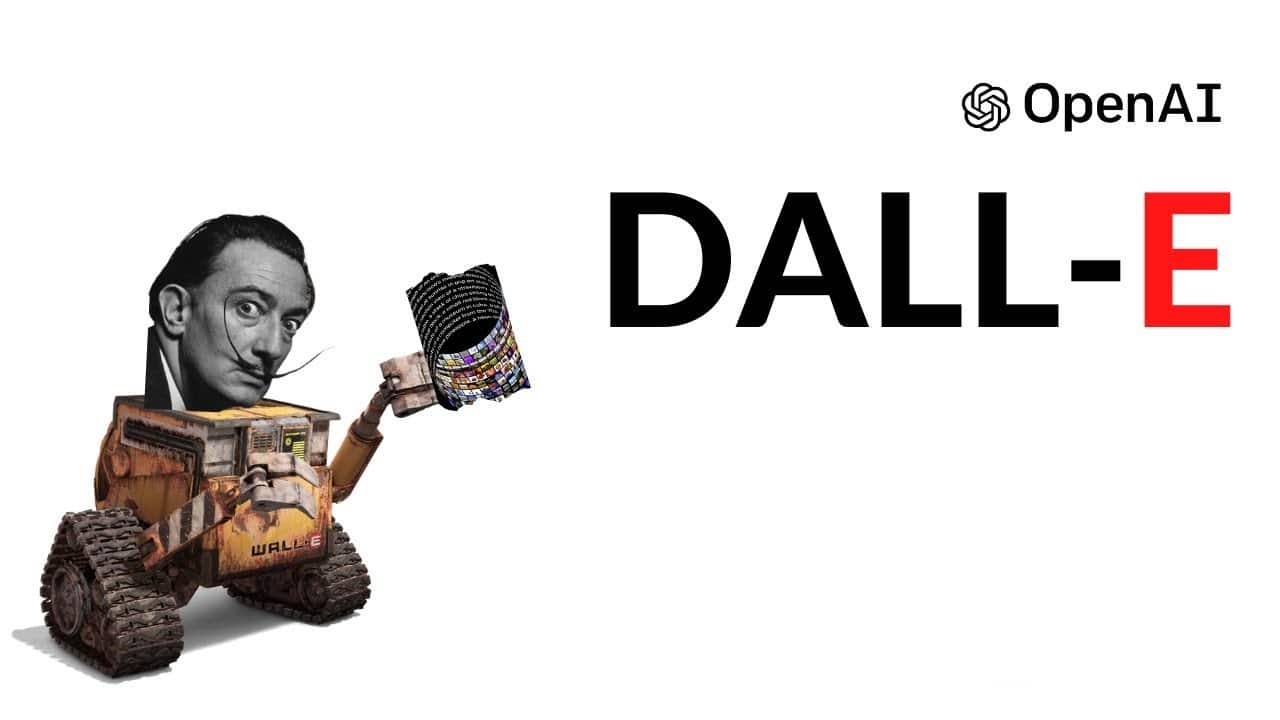

Fa pocs dies OpenAI va donar a conèixer que DALL-E 2, el sistema d'intel·ligència artificial que pot generar imatges a partir d'un avís o editar i refinar imatges existents, ja està disponible en versió beta i que a més accelerarà l'accés dels clients a la llista d'espera amb l'objectiu d'arribar al voltant d'1 milió de persones durant les properes setmanes.

Amb aquest llançament «beta», DALL-E 2, que era d'ús gratuït, passarà a una estructura de tarifes basada en crèdits. Els usuaris nous obtindran una quantitat limitada de crèdits que es poden utilitzar per generar o editar una imatge o crear una variació d'una imatge.

OpenAI va anunciar que convidaria més persones a provar-ho, doncs planeja deixar entrar fins a 1 milió de persones de la llista d'espera durant les properes setmanes a mesura que passa de la seva fase de recerca a la seva fase beta.

No és clar si DALL-E mai estarà completament disponible per al públic, però s'espera que l'expansió sigui una prova important per a la plataforma, amb molts investigadors monitoritzant com s'usarà indegudament la tecnologia.

OpenAI ha mantingut DALL-E monitorejada de prop per por que persones malintencionades utilitzin aquesta poderosa eina per difondre informació errònia. Imagina algú tractant de fer-lo servir per fabricar imatges de la guerra a Ucraïna o crear imatges realistes de desastres naturals que mai van succeir. A més, generar una imatge amb la plataforma consumeix tanta energia que els funcionaris de l'empresa temien que els seus servidors fallessin si massa persones intentaven fer-la servir alhora.

A més d'algunes altres característiques noves, la principal diferència amb aquest segon model és una gran millora en la resolució de la imatge, latències més baixes (el temps que porta crear la imatge) i un algorisme més intel·ligent per crear les imatges.

El programari no només crea una imatge amb un estil únic, pot afegir diferents tècniques artístiques segons ho sol·liciti, ingressant estils de dibuix, pintura a l'oli, model de plastilina, teixit de llana, dibuixat a la paret d'una cova o fins i tot com a pòster de pel·lícula dels anys 60.

També hi ha maneres d'incentivar Dall-E perquè produeixi contingut que el terme cerca filtrar. Si bé la sang activaria el filtre de violència, un usuari podria escriure «un toll de salsa de tomàquet» o una cosa semblant en un intent d'eludir-lo.

Quan es tracta de tecnologia al voltant de la creació d'imatges d'IA, sembla obvi que es podria manipular de moltes maneres: la propaganda, les notícies falses i les imatges manipulades vénen a la ment com a formes òbvies.

Per evitar això, l'equip d'OpenAI darrere Dall-E ha implementat una política de seguretat per a totes les imatges a la plataforma que funciona en tres etapes. El primer pas és filtrar les dades que inclouen una infracció important. Això inclou violència, contingut sexual i imatges que lequip consideraria inadequades.

A més de la política de seguretat de l'equip, tenen una política de contingut clara que els usuaris han de complir, doncs Joanne Jang, gerent de producte de DALL-E, diu que la companyia encara està perfeccionant les seves polítiques de contingut, que ara prohibeixen allò que caldria esperar*: crear contingut violent, pornogràfic i d'odi. L'empresa també prohibeix les imatges que representen urnes i protestes,

DALL-E també prohibeix les representacions de persones reals i planeja establir més mesures de seguretat a mesura que els investigadors aprenen com els usuaris interactuen amb el sistema.

«En aquest moment, creiem que hi ha moltes incògnites que ens agradaria manejar millor», va dir Jang. «Planejem augmentar i convidar ràpidament més i més persones a mesura que guanyem confiança».

Els experts diuen que si bé els algorismes d'imatges han existit durant un temps, la velocitat, la precisió i l'amplitud de DALL-E representen un avenç notable al camp.

“El que fa DALL-E és capturar un element de la imaginació humana. No és realment diferent de com els humans poden llegir un llibre i imaginar coses, però és poder capturar aquesta intel·ligència amb un algorisme”, va dir Phillip Isola, professor d'informàtica al MIT que va treballar anteriorment amb Open AI però que ja no està afiliat. «És clar, hi ha moltes preocupacions sobre com es pot fer un mal ús d'aquest tipus de tecnologia».

Finalment si estàs interessat en poder conèixer més a l'respecte, Pots consultar els detalls en el següent enllaç.